Comment fonctionne ChatGPT ? L'IA expliquée simplement

ChatGPT prédit le mot suivant, encore et encore. Voici comment un LLM transforme des milliards de mots en réponses qui semblent humaines — sans rien comprendre.

ChatGPT est un modèle de langage (LLM) entraîné sur des centaines de milliards de mots issus d'internet. Il ne "comprend" pas le langage — il prédit statistiquement le mot le plus probable à chaque étape. En décembre 2024, ChatGPT comptait 300 millions d'utilisateurs hebdomadaires et recevait 1 milliard de messages par jour.

📌 POINTS À RETENIR

- Pourquoi ChatGPT n'a aucune idée de ce qu'il dit — et pourquoi ça marche quand même

- Ce que sont les tokens et pourquoi ça explique les "bugs" bizarres de l'IA

- Comment des milliards de paramètres transforment du texte en réponses bluffantes

- Les vraies limites à connaître avant de faire confiance à une réponse de ChatGPT

⏱️ Temps de lecture : ~6 min

300 millions de personnes utilisent ChatGPT chaque semaine. Des avocats lui soumettent des contrats. Des médecins lui posent des questions de diagnostic. Des lycéens lui font rédiger leurs dissertations. Et pourtant, quasiment personne ne sait ce qui se passe sous le capot.

Alors, comment fonctionne cette chose qui semble penser ?

Comment fonctionne ChatGPT ? ChatGPT est un programme qui prédit le mot suivant le plus probable, encore et encore, à partir d'un entraînement sur des centaines de milliards de textes. Il ne comprend rien — il calcule des probabilités.

Ce qui suit va changer votre façon de l'utiliser.

ChatGPT, c'est quoi exactement ?

ChatGPT est développé par OpenAI, une entreprise américaine fondée en 2015. Le nom "GPT" signifie Generative Pre-trained Transformer — soit, en bon français : un transformateur génératif pré-entraîné.

Trois mots barbares pour une idée simple :

- Génératif : il produit du texte nouveau, il ne recopie pas

- Pré-entraîné : il a été formé sur un gigantesque corpus de textes avant d'être mis à disposition

- Transformer : c'est l'architecture mathématique qui lui permet de traiter le langage

ChatGPT appartient à la famille des LLM — Large Language Models, ou grands modèles de langage. C'est la même famille que Gemini (Google), Llama (Meta) ou Claude (Anthropic).

La version qui a rendu ChatGPT célèbre en novembre 2022, c'est GPT-3.5. Depuis, OpenAI a sorti GPT-4, GPT-4o, et continue d'améliorer le modèle régulièrement.

L'entraînement : comment ChatGPT a "appris"

Imaginez qu'on donne à lire à un enfant l'intégralité d'internet — Wikipedia, des millions de livres, des forums, des articles scientifiques, des conversations. Et qu'on lui pose ensuite des milliards de questions du type : "Quel mot vient après cette phrase ?"

C'est grosso modo ce qu'on a fait avec ChatGPT.

Durant la phase d'entraînement, le modèle a ingéré des centaines de milliards de mots. À chaque fois qu'il prédisait le mauvais mot suivant, ses paramètres internes étaient légèrement ajustés. Des milliards de corrections plus tard, il est devenu très fort pour prédire le texte probable.

GPT-4, la version actuelle de référence, possède environ 1 750 milliards de paramètres — autant de petits curseurs numériques ajustés pendant l'entraînement pour affiner les prédictions.

Les tokens : l'alphabet secret de ChatGPT

ChatGPT ne lit pas les mots comme vous. Il découpe le texte en tokens — des fragments de mots, parfois des mots entiers, parfois juste quelques caractères.

Par exemple, le mot "bonjour" pourrait être découpé en deux tokens : "bon" + "jour". Le mot "intelligence" en trois ou quatre.

Pourquoi ce découpage bizarre ? Pour des raisons mathématiques et de performance : les tokens permettent au modèle de gérer efficacement les langues, les pluriels, les conjugaisons.

Quelques chiffres utiles selon OpenAI :

- 1 token ≈ 4 caractères en anglais

- En français, c'est un peu moins efficace — environ 22% de tokens supplémentaires pour le même texte

- GPT-4 peut traiter jusqu'à 128 000 tokens dans une seule conversation (son "contexte")

C'est aussi pour ça que ChatGPT se trompe parfois en comptant des lettres ou en faisant des anagrammes : il ne voit pas les lettres individuellement, mais des blocs de tokens.

💡 ASTUCE Si ChatGPT vous donne des réponses de moins bonne qualité sur de très longs documents, c'est souvent parce que son "contexte" est saturé. Découpez votre document en parties et soumettez-les séparément.

Comment ChatGPT génère du texte

C'est la partie magique — et la plus contre-intuitive.

Quand vous envoyez un message à ChatGPT, voici ce qui se passe réellement :

- Votre texte est découpé en tokens

- Le modèle calcule, pour chaque token possible du vocabulaire, une probabilité d'apparaître en suivant

- Il choisit parmi les tokens les plus probables (avec une part d'aléatoire contrôlée)

- Ce token est ajouté à la réponse, et le processus recommence token par token

C'est exactement comme la fonction d'autocomplétion de votre clavier de smartphone — mais avec 1 750 milliards de paramètres au lieu de quelques dizaines de règles simples.

| Ce que vous imaginez | Ce qui se passe vraiment |

|---|---|

| ChatGPT "réfléchit" à votre question | Il prédit le token le plus probable |

| Il "comprend" votre intention | Il calcule des patterns statistiques |

| Il "sait" des choses | Il a mémorisé des corrélations textuelles |

| Il est sûr de ses réponses | Il est sûr de ses probabilités — pas de la vérité |

⚠️ ERREUR COURANTE Faire confiance à ChatGPT pour des informations factuelles précises (dates, chiffres, citations) sans vérifier. — Solution : traitez ChatGPT comme un assistant de rédaction brillant, pas comme une encyclopédie. Recoupez toujours les faits importants.

Les limites que tout le monde devrait connaître

ChatGPT est impressionnant. Mais comprendre son fonctionnement, c'est aussi comprendre pourquoi il échoue — et comment.

Il hallucine. Puisqu'il prédit du texte probable plutôt que du texte vrai, il peut inventer des sources, des noms, des dates qui semblent totalement crédibles. Ce phénomène s'appelle une "hallucination". Il ne ment pas — il génère du texte statistiquement plausible qui peut s'avérer factuellement faux.

Sa date de coupure. ChatGPT a été entraîné sur des données jusqu'à une certaine date. Il ne connaît pas les événements récents, sauf si vous lui fournissez l'information dans votre message ou si vous utilisez la fonctionnalité de recherche web (disponible sur certaines versions).

Il ne raisonne pas vraiment. Les dernières versions (GPT-4o, o1) sont bien meilleures en logique et mathématiques, mais un LLM classique échoue souvent sur des raisonnements qui paraissent simples à un humain. Il suit des patterns, pas une logique formelle.

Il est vulnérable aux manipulations. Des techniques comme le "prompt injection" permettent parfois de contourner ses garde-fous. C'est d'ailleurs une nouvelle surface d'attaque pour les pirates — les mails de phishing générés par IA sont désormais beaucoup plus convaincants qu'avant, précisément parce que les LLM écrivent sans fautes.

FAQ — Comment fonctionne ChatGPT

ChatGPT est-il intelligent ?

Pas au sens humain du terme. ChatGPT est extrêmement performant pour traiter et générer du langage, mais il ne possède ni conscience, ni compréhension, ni intentions. Il n'a pas d'objectifs propres. Il génère du texte statistiquement cohérent sans "savoir" ce qu'il dit. La question de l'intelligence artificielle générale (AGI) reste ouverte dans la communauté scientifique.

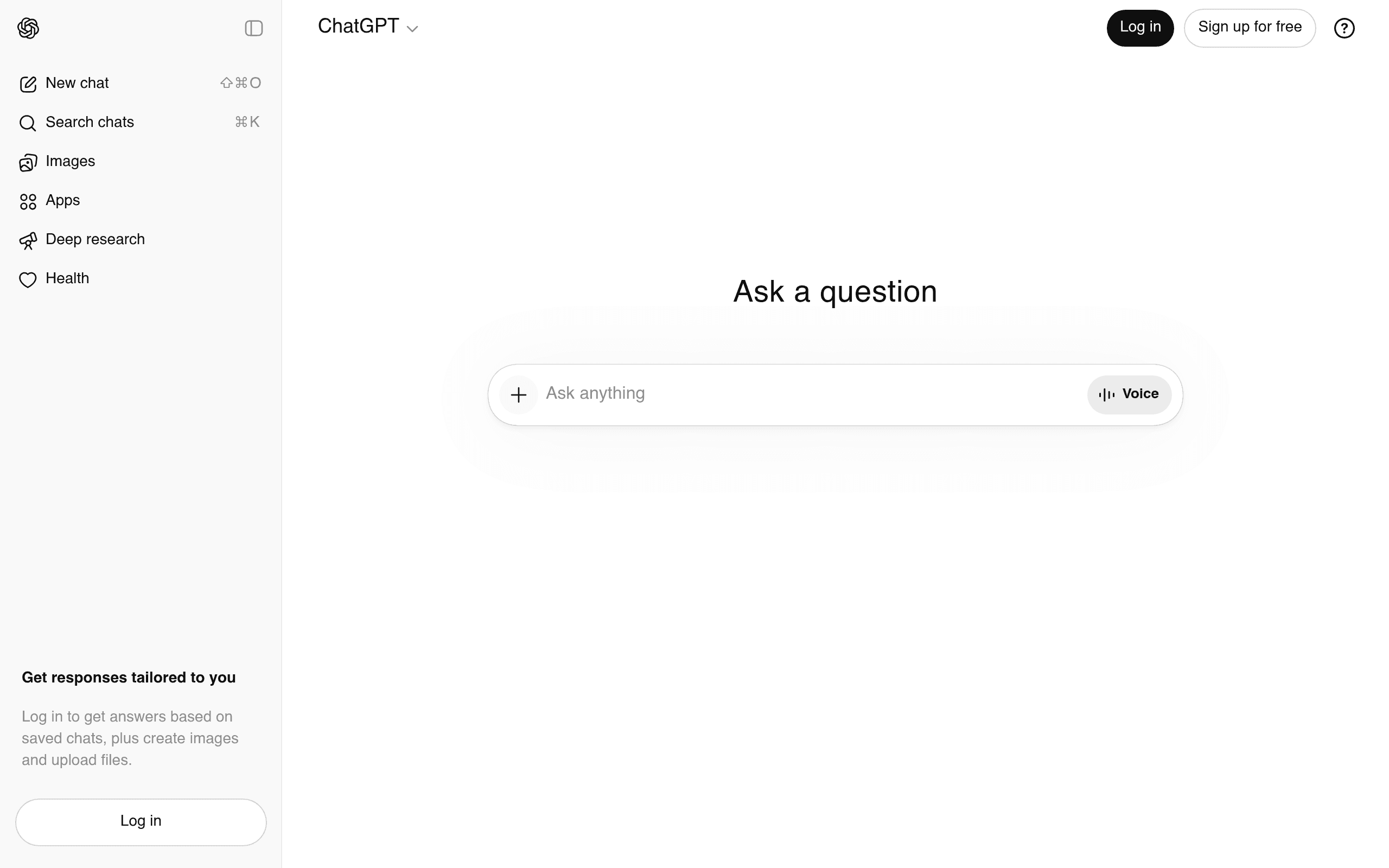

Quelle est la différence entre ChatGPT et GPT-4 ?

ChatGPT est le produit — l'interface conversationnelle accessible sur chat.openai.com. GPT-4 est le modèle de langage qui le fait tourner. C'est comme la différence entre votre navigateur web (le produit) et le moteur V6 sous le capot (le modèle). Selon The Verge, ChatGPT a dépassé 300 millions d'utilisateurs hebdomadaires fin 2024.

ChatGPT peut-il accéder à internet ?

La version gratuite de base, non. Mais ChatGPT Plus (version payante) propose une fonctionnalité de navigation web qui permet au modèle de rechercher des informations en temps réel. Sans cette option activée, ChatGPT ne connaît que ce qui existait avant sa date de coupure d'entraînement. Si votre connexion est instable, gardez à l'esprit que la qualité des échanges peut aussi dépendre de votre débit.

ChatGPT peut-il se tromper ?

Oui, fréquemment. Les "hallucinations" — réponses inventées mais plausibles — sont un problème connu de tous les LLM. ChatGPT peut citer une source qui n'existe pas, inventer une date, ou affirmer avec confiance quelque chose de faux. Vérifiez toujours les informations critiques, surtout dans des domaines comme la santé, le droit ou les finances.

Conclusion

ChatGPT, au fond, c'est une autocomplete surpuissante. Un programme qui a lu une quantité astronomique de textes et qui a appris à prédire, token par token, ce qui devrait venir ensuite.

Les 3 points à retenir :

- ChatGPT prédit du texte probable — il ne comprend pas, il calcule

- Il peut halluciner des faits convaincants mais faux — vérifiez toujours

- Sa puissance vient de milliards de paramètres affinés sur des centaines de milliards de mots

Ça ne le rend pas moins utile — au contraire. Savoir comment il fonctionne, c'est savoir comment bien l'utiliser.

Prochaine étape ? Si vous utilisez ChatGPT au quotidien, sachez que les pirates s'en servent aussi pour fabriquer des arnaques plus convaincantes. Notre guide pour reconnaître un mail de phishing généré par IA vous donnera les bons réflexes.

Auteur

Julien Moreau

Expert informatique & technologie depuis 14 ans. Ancien ingénieur système, je rends les sujets tech complexes accessibles à tous les curieux du numérique.

Voir le profil de Julien